Nota editorial (2025): publicado originalmente en 2020. Se añadió una versión estructurada con fines enciclopédicos. El texto original se conserva íntegro como parte del archivo histórico.

Dilemas Éticos en torno a Seguridad y Privacidad de Dispositivos Inteligentes

Se ha reportado un incidente reciente que pone en tela de juicio los dilemas éticos relacionados con la seguridad e integridad de nuestros dispositivos inteligentes. Un usuario experimentó una falsificación audible del humo por su asistente digital durante la cocina, lo cual generó incomodidades en el hogar.

Incidente Detallado

- Usuario estaba realizando labores culinarias cuando se activó su detector de humo instalado a $10, generando un pitido audible y la alarma.

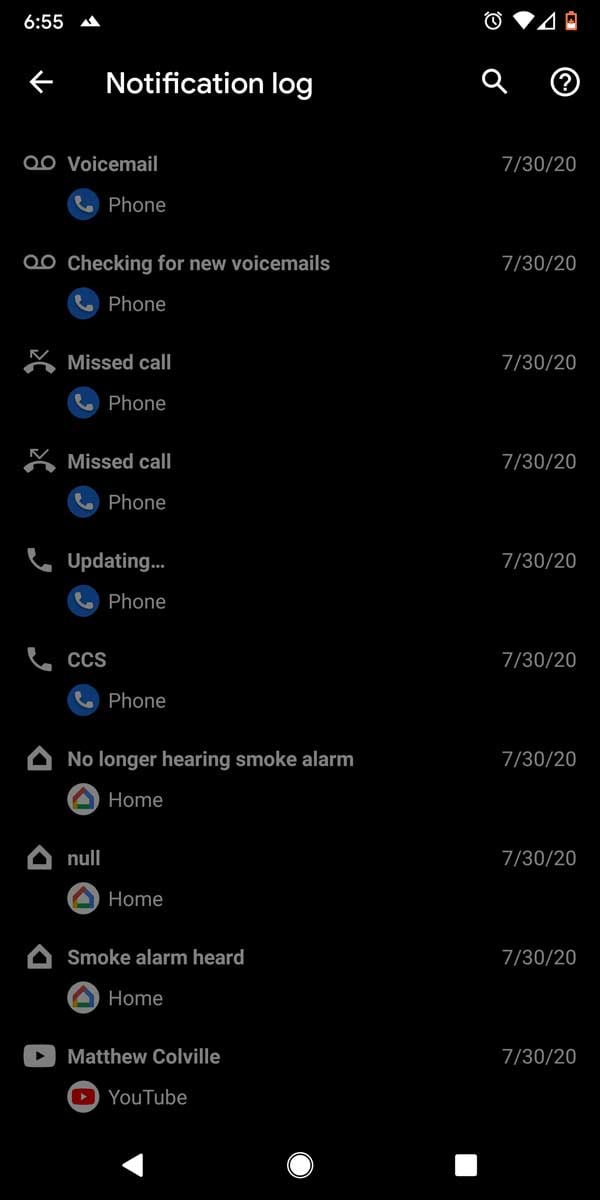

- Posteriormente, el asistente digital del usuario mediante Google Home dio una notificación errónea indicando que había oído ‘el sonido de los humos’, lo cual fue incorrecto ya que no tiene conexión inteligente directa con la alarma.

- Otros anécdotas reportadas por usuarios incluyen falsificaciones auditivas relacionadas con ruidos como vasos rompiéndose y otros sonidos agudos. A pesar de que estos casos parecen ser recurrentes, la compañía Google ha desactivado esa función.

Comentarios Públicos e Información Actualizada por Parte de Google

Google reconoció una activación no intencionada en su asistente vocal a través de un comunicado oficial, que afirmó haber sido accidental debido a una reciente actualización del software. A pesar de la utilidad percibida en términos de seguridad al utilizar tales alertas erróneamente activadas por el dispositivo, se plantean serias preocupaciones relacionadas con la invasión de privacidad y autenticidad debido a que estas notificaciones sugieren que su asistente está ‘escuchando’ más del que lo reportado. Aún estamos en una situación donde los dispositsivos inteligentes parecen mostrar un comportamiento complejo y potencialmente no ético.

Preguntas frecuentes

«`html

Preguntas frecuentes (FAQs) sobre los dilemas éticos relacionados con la seguridad e integridad de dispositivos inteligentes: Incidente reciente en cocina y falsificación audible del humo

¿Qué ocurrió durante el incidente reportado?

Un usuario que estaba cocinando activó su detector de humo a través de un comando, lo cual causó la alarma. Luego, Google Home dio una notificación erronea indicando que había ‘escuchado’ los sonidos del humo.

¿Por qué se produjo esta falsificación audible?

Se atribuye la activación no intencionada al asistente vocal de Google debido a una reciente actualización del software que causó el comportamiento anormal.

¿Qué reacción se tuvo ante tales incidentes?

Existe preocupación por la privacidad y autenticidad, ya que las notificaciones sugieren un nivel de ‘escucha’ más allá del reportado. Además, Google ha desactivado esa función tras los anécdotas recurrentes.

¿Cómo puede afectar esto el uso ético y seguro de dispositivos inteligentes?

Este incidente pone en tela de juicio cómo interactuamos con nuestros dispositivos para garantizar la privacidad mientras buscamos una mayor seguridad.

¿Qué medidas está tomando Google tras estos reportes?

Google reconoció el incidente como accidental y ha desactivado esa función de asistente vocal para prevenir futuras falsificaciones no intencionadas.

¿Qué se considera una respuesta ética ante estos dilemas?

Una posible solución sería implementar controles más estrictos y claros sobre las notificaciones de seguridad, asegurando que los dispositivos inteligentes no infrinjan la privacidad sin consentimiento explícito.

¿Cómo podría impactar esto en el uso cotidiano de estos dispositivos?

Puede causar distracción y confusión, afectando poten0cialmente la fiabilidad percibida e integridad del asistente digital.

¿Qué medidas adicionales pueden implementarse para mejorar las prácticas éticas?

Podrían tomarse medidas como actualizaciones más frecuentes, pruebas de falsificación auditiva y mecanismos que requieran confirmación antes de notificar alarmas no intencionadas.

«`

Texto original (2020)

Un caso reciente revela preocupantes dilemas éticos en torno a la seguridad y privacidad de nuestros dispositivos inteligentes. Un usuario experimentó una falsificación audible del humo por su asistente digital, poniendo en tela de juicio la confiabilidad actualmente otorgada a estos sistemas informáticos.

Todo se descubrió en medio de una emergencia de un usuario al cocinar.

Este descubrimiento nos pone a pensar hasta qué punto confiamos en lo que nos dicen que hacen los dispositivos y lo que realmente hacen

Hace unos días, el usuario brazedowl recibió una extraña notificación en el móvil. Él estaba cocinando en su casa, y se le quemó algo de comida, lo que hizo que saltase el detector de humos de 10 dólares que tenía instalado en la cocina. Sin embargo, lo curioso vino cuando el Asistente de Google a través de la app de Google Home, le dijo «He oído la alarma de humos», para posteriormente decir que ya había dejado de oírla. El detector de humos no tiene ningún tipo de conectividad inteligente, por lo que la detección fue por el pitido emitido por el detector y escuchado por su altavoz Google Home

Esto es realmente curioso, ya que los dispositivos de Google sólo se deben activar usando las palabras clave. Otros usuarios afirman que este caso no es único, sino que también han visto cómo el Asistente de Google les alertaba de haber escuchado sonidos como vasos rompiéndose, plástico de burbujas explotando, un compresor de aire, y otros sonidos agudos como los pitidos de las alarmas.

Google ya ha desactivado la función activada «por error»

Google ha emitido un comunicado afirmando que la activación de esta función por defecto fue accidental a través de una reciente actualización de software, pero que ya han desactivado la función.

Aunque la función es muy útil en términos de seguridad, en realidad estamos ante una gravísima invasión de la privacidad, ya que al parecer el asistente de voz está escuchando mucho más de lo que la compañía afirma sin que el usuario tenga que llamar al asistente.

Vía ADSL Zone

Foto: Bernard Hermant | Unsplash