Por Rosana Bartet

Miembro del equipo de Habitium.com

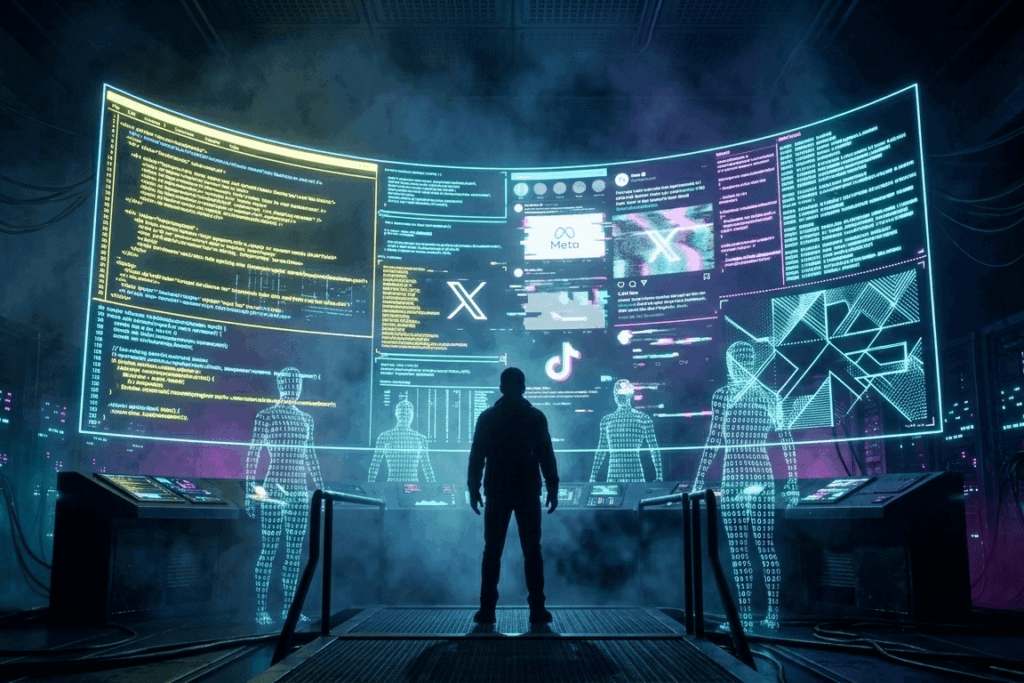

En el ecosistema digital de 2026, la verdad ya no se mide desde la evidencia, sino por el volumen. Mientras lees esto, miles de cuentas automatizadas están librando una guerra invisible en el muro de noticias, moldeando opiniones y decidiendo qué temas merecen la atención y cuáles deben ser silenciados. No es una compleja teoría de conspiración; es una industria multimillonaria que ha perfeccionado el arte de fabricar «consenso artificial».

En LoQueSigue, analizamos cómo las granjas de bots han evolucionado de ser simples scripts repetitivos a sofisticados sistemas de IA que imitan el comportamiento humano con precisión aterradora. En esta radiografía, desmantelamos la maquinaria detrás del trending topic para entender quién mueve los hilos detrás de la conversación pública.

Anatomía del Engaño: Del Bot de Spam al «Cyborg» con IA

Para entender cómo nos manipulan, primero debemos identificar a los soldados de este ejército digital. Ya no se trata solo de cuentas sin una foto de perfil que repiten una misma frase; la tecnología evolucionó y ha dado un salto cualitativo.

El Bot de Ataque (Scripting Básico)

Son cuentas de bajo costo, diseñadas para el volumen masivo. Su función es el «astroturfing»: crear la ilusión de un apoyo popular que no existe. Es posible detectarlas fácilmente por su alta frecuencia de posteo (hasta 1,000 interacciones por hora) y su lenguaje genérico.

El «Cyborg» Digital

Esta es la herramienta más peligrosa actualmente. Son cuentas gestionadas por humanos que utilizan herramientas de automatización para potenciar su alcance. Tienen biografías creíbles, fotos generadas por IA que evitan la búsqueda inversa de Google y mantienen conversaciones reales para ganar confianza antes de soltar la desinformación programada.

Granjas de IA Generativa (Modelos LLM)

En 2026, las granjas utilizan modelos de lenguaje personalizados. Ya no verás el mismo mensaje copiado 100 veces. Verás 100 opiniones distintas, con matices diferentes, pero todas apuntando hacia el mismo objetivo político o comercial. Esto hace que los filtros de detección de las plataformas resulten, a menudo, insuficientes.

Dato Clave: Según métricas recientes, se estima que hasta el 40% del tráfico global en redes sociales no proviene de seres humanos, sino de agentes automatizados con objetivos de influencia.

El Mercado Negro del Like: ¿Cuánto cuesta fabricar una tendencia?

La manipulación digital no es una inocente labor de entusiastas; es una industria de servicios con catálogos de precios tan estructurados como cualquier agencia de marketing legítima. En el «subsuelo» de la red, la opinión pública tiene un increíble costo transaccional.

A continuación, desglosamos las tarifas promedio y las tácticas que las granjas de bots emplean para secuestrar la conversación en plataformas como X (Twitter), TikTok y Facebook.

Tabla de Costos: El Menú de la Manipulación (Estimados 2026)

| Servicio | Descripción | Costo Estimado (USD) | Objetivo |

| Trend Hijacking | Posicionar un Hashtag en el Top 5 por 3 horas. | $1,500 – $3,500 | Dominar la agenda del día. |

| Ataque de Desprestigio | 10,000 comentarios negativos coordinados. | $500 – $800 | Silenciar a una voz crítica o periodista. |

| Inflado de Autoridad | 50,000 seguidores «Premium» (con bio y fotos de IA). | $250 – $400 | Dar credibilidad a una cuenta nueva. |

| Campaña de Shadowban | Denuncias masivas coordinadas por «incumplimiento». | $1,200 | Lograr que la plataforma suspenda a un rival. |

| Deepfake Bot | Video corto de una figura pública diciendo algo polémico. | $2,000+ | Generar caos informativo inmediato. |

Tácticas de Infiltración: Más allá del spam

Las granjas modernas ahora no solo «bombardean», astutamente infiltran. Utilizan estrategias psicológicas para que el algoritmo trabaje a su favor:

- El «Efecto Arrastre»: Comienzan con 500 cuentas verificadas (compradas) comentando una publicación. El algoritmo detecta «interacción de calidad» y comienza a mostrar el post a usuarios reales, quienes terminan compartiendo la desinformación sin saber que el origen fue artificial.

- Ataques en «Enjambre»: No atacan todo el día. Concentran miles de interacciones en una ventana de 15 minutos. Esto engaña a los sistemas de detección de picos de tráfico, haciendo que la tendencia parezca orgánica y explosiva.

- Secuestro de Palabras Clave: Utilizan términos populares pero neutrales (como el nombre de un evento deportivo o un clima extremo) para insertar mensajes políticos o de odio dentro de la conversación general.

Nota de Análisis: El peligro real no consiste en que los bots nos convenzan de algo, sino que logren que dejemos de creer en todo. Al inundar la red con ruido, la verdad se vuelve indistinguible del engaño, logrando el objetivo final de cualquier sistema autoritario: la apatía social.

Guía de Autodefensa: 5 señales para detectar un perfil de infiltración en 2 minutos

No necesitas ser un experto en ciberseguridad para identificar a los soldados de una granja de bots. Los algoritmos de manipulación, aunque avanzados, suelen dejar huellas dactilares digitales. Antes de dar por fidedigno, compartir o enfurecerte con un comentario, aplica este filtro rápido:

1. El «Síndrome del Recién Nacido»

Revisa la fecha de creación. Las granjas suelen activar «oleadas» de cuentas antes de eventos críticos (elecciones, crisis sociales o lanzamientos).

- Red Flag: Una cuenta creada hace menos de 3 meses que ya tiene miles de publicaciones y solo habla de un tema específico.

2. El Test de la Imagen Generada (IA)

En 2026, los bots ya no emplean fotos de modelos de stock, actualmente usan fotos generadas por IA.

- Cómo detectarlo: Mira los detalles finos. ¿Los aretes son asimétricos? ¿El fondo parece «derretido» o borroso sin sentido? ¿Hay una coherencia extraña en la iluminación de la piel? Si la foto parece demasiado perfecta pero el fondo es un caos, desconfía.

3. El Patrón de «Metralleta» (Frecuencia de Posteo)

Ningún humano normal publica 80 tuits o comentarios en una hora, las 24 horas del día.

- Tip: Si entras al perfil y ves que responde a decenas de personas diferentes con argumentos casi idénticos en cuestión de segundos, estás ante un proceso automatizado o un «cyborg» operando bajo un guion.

4. La «Cámara de Eco» en sus Seguidores

Haz clic en sus seguidores.

- La señal: Si la mayoría de sus seguidores no tienen biografía, tienen nombres genéricos seguidos de números (ej. Juan8374652) y todos se siguen entre sí en un círculo cerrado, es una red de apoyo artificial diseñada para inflar métricas.

5. Incongruencia de Intereses

Un usuario real tiene matices: habla de futbol, de su perro, de una serie y, ocasionalmente, de política.

- El Bot: Solo tiene un «mono-tema». Su línea de tiempo es un desierto de contenido personal y un oasis de propaganda o ataques coordinados.

Consejo Pro: Si sospechas de una cuenta, no le respondas directamente. El algoritmo de las plataformas interpreta cualquier interacción (incluso un insulto) como «contenido relevante» y le da más alcance. Reporta, bloquea y no alimentes al algoritmo.

Conclusión

Para finalizar este artículo con éxito SEO, te sugiero un cierre que invite a la reflexión:

«La batalla por la verdad no se libra en los servidores de las grandes tecnológicas, sino en nuestra capacidad de pausar antes de hacer clic. En un mundo de ruido artificial, el pensamiento crítico es nuestro único firewall.»

Preguntas Frecuentes (FAQ)

- ¿Es ilegal contratar una granja de bots para una campaña?

En la mayoría de los países, no existe una ley penal específica que prohíba la compra de interacciones. Sin embargo, infringe los Términos de Servicio de las plataformas (X, Meta, TikTok), lo que puede resultar en el cierre permanente de las cuentas. El vacío legal ocurre cuando estas granjas se usan para difamación o fraude electoral, donde sí podrían entrar en juego leyes de honor o delitos cibernéticos.

- ¿Cómo afectan los bots al alcance orgánico de un usuario común?

Negativamente. Los algoritmos priorizan el contenido con «interacción rápida». Cuando una granja infla artificialmente un tema, desplaza el contenido real de los usuarios hacia el fondo del feed. Esto crea una percepción distorsionada de la realidad donde las voces auténticas quedan sepultadas por el ruido programado.

- ¿Existen bots «buenos» en las redes sociales?

Sí. No toda la automatización es maliciosa. Existen bots de servicio al cliente, bots informativos (que publican alertas sísmicas o del clima) y bots artísticos. La diferencia radica en la transparencia: los bots legítimos suelen identificarse como tales en su biografía, mientras que las granjas de manipulación buscan engañar al usuario haciéndose pasar por personas reales.

- ¿Pueden las plataformas detectar y borrar todos los bots?

No totalmente. Es una carrera armamentista tecnológica. Cada vez que una red social actualiza su sistema de detección, los desarrolladores de granjas utilizan IA generativa para hacer que sus bots actúen de forma más humana (cometiendo errores ortográficos intencionales, siguiendo horarios de sueño, etc.). Es un juego del gato y el ratón que nunca termina.

- ¿Qué debo hacer si una granja de bots comienza a atacarme?

Lo más efectivo es poner tu cuenta en modo privado temporalmente. Los bots están programados para objetivos masivos; si les quitas la capacidad de interactuar contigo y no les das «combustible» (respuestas), la campaña perderá efectividad y se moverá hacia un objetivo más fácil. Reportar masivamente las cuentas atacantes también ayuda a que el algoritmo las identifique más rápido.